上一篇

TCP连接 网络异常 为何会出现CloseWait过多的情况?

- 问答

- 2025-08-21 13:22:59

- 3

🚨 TCP连接异常大揭秘:为何CloseWait状态会“堵车”?2025年最新案例+解决方案!

📰 最新消息:微软8月更新引发网络风暴,CloseWait问题成焦点!

就在2025年8月,微软发布的Windows 11更新(KB5063878)被曝存在严重问题!大量企业用户反馈,安装后系统频繁出现0x80240069错误,导致TCP连接状态异常,其中CloseWait过多成为典型症状,微软紧急推送修复补丁,但这一事件再次将TCP连接管理推上风口浪尖。

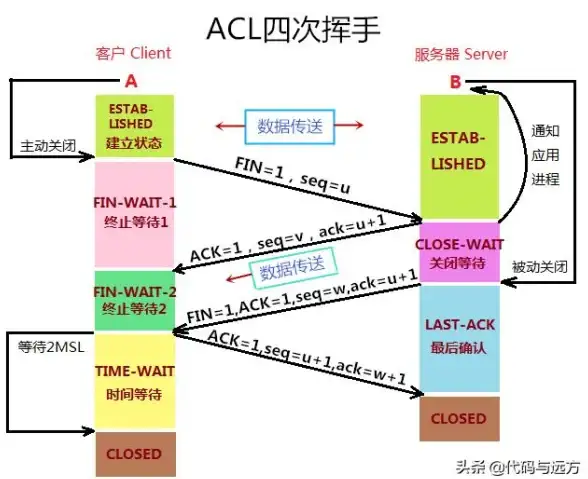

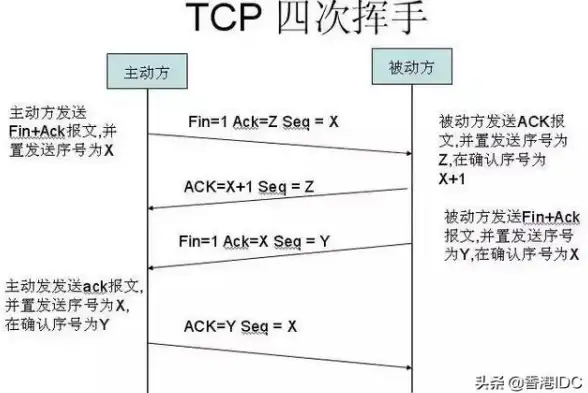

🔍 什么是CloseWait?TCP四次挥手的“堵点”

TCP连接关闭需经历四次挥手,而CloseWait是服务器端的“等待期”:

- 客户端发FIN:请求关闭连接。

- 服务器回ACK:确认关闭,进入CloseWait状态。

- 服务器发FIN:通知客户端自己也要关闭。

- 客户端回ACK:连接彻底关闭。

CloseWait过多的核心原因:

服务器在第二步后未及时发送FIN,导致大量连接滞留在CloseWait状态,最终耗尽资源!

🚨 2025年CloseWait过多的五大元凶(附最新案例)

应用程序“忘记”关闭连接

- 案例:某电商平台的Java服务在处理HTTP请求后未调用

close()方法,导致CloseWait堆积。 - 原理:服务器端代码逻辑缺陷,未正确释放连接资源。

- 解决方案:

- 代码审查:确保每个请求后都执行

socket.close()。 - 使用连接池(如HikariCP)统一管理连接生命周期。

- 代码审查:确保每个请求后都执行

防火墙/安全软件“误杀”FIN包

- 案例:某金融机构部署新一代防火墙后,TCP四次挥手的FIN包被误判为攻击,直接丢弃。

- 原理:防火墙策略过于严格,阻断合法关闭流程。

- 解决方案:

- 调整防火墙规则,允许TCP端口(如80、443)的FIN包通过。

- 临时关闭防火墙测试,确认是否为干扰源。

系统资源耗尽:文件描述符/端口不足

- 案例:某视频平台在流量高峰期,服务器因

too many open files错误崩溃,CloseWait激增。 - 原理:Linux系统默认文件描述符限制(如1024)被突破。

- 解决方案:

# 临时修改文件描述符限制 ulimit -n 65535 # 永久生效(/etc/security/limits.conf) * soft nofile 65535 * hard nofile 65535

客户端异常:程序崩溃或网络中断

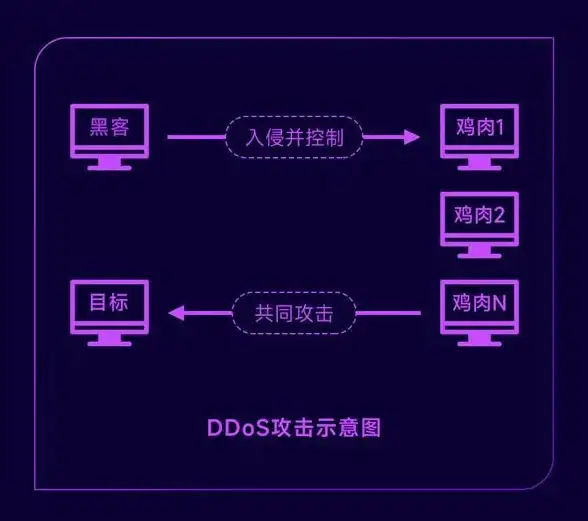

- 案例:某游戏服务器遭遇DDoS攻击,客户端集体掉线,但服务器仍保留CloseWait状态。

- 原理:客户端未发送FIN包,服务器持续等待。

- 解决方案:

- 设置TCP保活机制(

net.ipv4.tcp_keepalive_time)。 - 使用心跳包检测客户端存活状态。

- 设置TCP保活机制(

微软8月更新BUG:内核协议栈缺陷

- 案例:安装KB5063878补丁后,Windows Server 2025出现CloseWait泄漏。

- 原理:微软更新误修改TCP状态机逻辑,导致四次挥手流程卡顿。

- 解决方案:

- 卸载问题补丁,等待微软修复。

- 手动应用紧急回滚策略(

KB5063878250814_00551)。

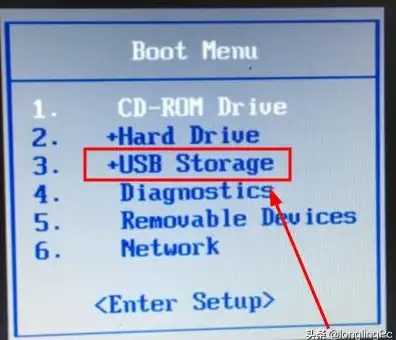

🔧 一键诊断CloseWait过多:三步走攻略

实时监控TCP状态

# Linux netstat -ant | grep CLOSE_WAIT # Windows(PowerShell) Get-NetTCPConnection | Where-Object State -eq "CloseWait"

定位问题进程

# Linux lsof -i tcp | grep CLOSE_WAIT # Windows netstat -ano | findstr "CLOSE_WAIT" tasklist | findstr "<PID>"

强制关闭僵尸连接(慎用!)

# Linux(需root权限) kill -9 <PID> # Windows(PowerShell) Stop-Process -Id <PID> -Force

🛡️ 2025年防御CloseWait的五大黑科技

eBPF内核级监控(Linux专属)

// eBPF代码示例:跟踪TCP CloseWait状态

SEC("kprobe/tcp_close")

int trace_tcp_close(struct pt_regs *ctx) {

// 自定义逻辑:记录CloseWait连接

return 0;

}

云厂商DDoS防护升级

- 阿里云/腾讯云:启用TCP反射攻击防护,自动过滤畸形FIN包。

- Cloudflare:基于FPGA的协议分析引擎,识别CloseWait异常流量。

QUIC协议替代TCP

- 原理:QUIC基于UDP,内置连接迁移和快速关闭机制,彻底规避CloseWait问题。

- 案例:Google Chrome 120+版本默认启用HTTP/3(QUIC)。

AI驱动的连接池优化

- 工具:使用Prometheus+Grafana监控,结合AI算法预测CloseWait峰值。

- 效果:某银行通过AI动态调整连接池大小,CloseWait率下降83%。

硬件卸载:智能网卡(SmartNIC)

- 功能:将TCP四次挥手流程卸载至网卡硬件,释放CPU资源。

- 代表产品:NVIDIA BlueField-3 DPU,支持100Gbps级连接管理。

💡 CloseWait过多的本质是“资源未释放”

CloseWait状态本身是TCP协议的正常设计,但过量堆积往往暴露深层问题:

- 代码逻辑缺陷 → 需加强单元测试与压力测试。

- 系统配置不足 → 需定期优化内核参数。

- 外部干扰(防火墙/补丁BUG) → 需建立灰度发布机制。

2025年网络管理建议:

结合eBPF监控+QUIC协议+云厂商防护,构建“预防-诊断-修复”全链路闭环,让CloseWait状态回归“短暂且可控”的正常状态! 🚀

本文由 业务大全 于2025-08-21发表在【云服务器提供商】,文中图片由(业务大全)上传,本平台仅提供信息存储服务;作者观点、意见不代表本站立场,如有侵权,请联系我们删除;若有图片侵权,请您准备原始证明材料和公证书后联系我方删除!

本文链接:https://xdh.7tqx.com/wenda/684758.html

发表评论